AI 人工智慧並不是全新的概念,早在本世紀初,知名導演史蒂芬 · 史匹柏(Steven Spielberg)就曾執導過以此為名的大製作電影。不過許多民眾等到 2022 年,和 ChatGPT 等有問必答的程式親身互動,才脫離科幻想像,對 AI 有更親切的體驗感。

每個人都能隨時使用 AI,已經是無法逆轉的趨勢!但是這帶來一個問題:AI 運行需要的資料量、運算量大幅上升,手機電池的電量卻依然有限。如果不改用新的演算架構,僅靠不到兩倍的電量成長,根本無法支撐百倍以上的算力需求。

各有所長的序列與平行運算

其實互動程式普及以前,智慧型手機的用戶早已不自覺地使用 AI。國立成功大學電機工程學系的蔡家齊助理教授舉例,日常的「手機拍照」,每一次按下快門後的降噪與美化,背後都有 AI 的介入。

都是「晶片」組成的處理器,AI 到底需要什麼不同的運算能力?這要回到處理器的設計本質來看。運算系統可分為通用型與專用型,大部分電腦使用的中央處理器(Central Processing Unit, CPU)是通用型的處理器,圖形處理器(Graphics Processing Unit, GPU)則是特別設計過,使用於影像渲染、影片編輯等特定目的。在特定領域內,GPU 的表現遠勝 CPU,領域之外卻不適用。

在設計理念上,CPU 專精於「序列化」任務,GPU 則擅長「平行化」處理。蔡家齊助理教授用「寫字」生動比喻:CPU 就像擁有一隻「手速極快」的手,必須一字一句、按順序寫完一篇文章(序列化);而 GPU 雖然單手寫字的速度較慢,卻彷彿擁有「無數隻手」能同時動筆(平行化)。在不需要按順序的前提下,GPU 能多管齊下,大幅縮短完成整篇文章的時間。

最初,GPU 是為了處理華麗的視覺效果而生,衍生出我們熟悉的「顯示卡」。然而,由於「平行運算」的特質與 AI 處理海量數據的需求完美契合,隨著 AI 科技爆發,GPU 自然順理成章地成為 AI 運算的主力。這正是以 GPU 起家的科技公司能躍升為全球 AI 霸主的關鍵。如今,面對龐大且多變的 AI 需求,市場上不僅湧現出越來越多「專為 AI 優化的 GPU」,直接針對 AI 量身打造的專屬晶片也已躍上一線主流。

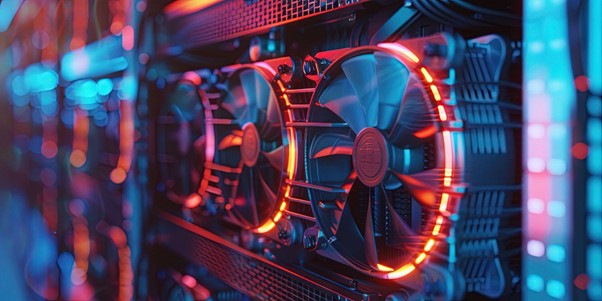

圖 1 已經有了 GPU,為什麼我們還需要「專屬 AI 晶片」?

圖片來源:Pixabay(https://pixabay.com/illustrations/ai-generated-gpu-cpu-server-8571840/)

為何需要專屬 AI 晶片?在「效能」與「效率」間取捨

既然 GPU 這麼好用,為什麼目前業界還要積極研發「更專門的 AI 晶片」?核心關鍵在於:AI 裝置不僅需要算力,更需要極致的「效率」。

蔡家齊助理教授指出,提升 AI 的「效能(Performance)」與「效率(Efficiency)」,其實是不同概念,大部分時候 AI 裝置最優先的目標,是提升效率。

以車輛舉例,超跑馬力大,可以瞬間衝刺,這是「效能」強大,卻極為耗油,續航力較差;某些馬力不高的車,加速能力一般,卻非常省油,相同油量能行駛更遠的距離,這是「效率」優秀。

AI 運算極度耗電,但對於手機、智慧門鈴這類由電池供電的「邊緣裝置」來說,不可能無限制地加大電池。因此,針對這些裝置設計的專屬 AI 晶片,首要目標便是追求「高效率」——在耗費相同電力的情況下,榨出更多的運算量。相對地,不受電池拘束的雲端伺服器,則更有餘裕去追求極致的高效能。

此外,算力也並非「愈強愈好」,而是要看應用場景。例如,自駕車辨識路況可能只需低精度的 8 位元計算,便能兼顧安全與省電;但若是精密的醫療腫瘤偵測,或遙遠宇宙星體的軌跡計算,就需要最高精度的 64 位元支持。因為使用目的不同,硬體規格自然不同,這促使了各式專用 AI 晶片的百花齊放。

舉例來說,除了大家熟知的 GPU,目前市場上還有幾款具話題性的「專屬 AI 晶片」:

這些因應不同任務而生的處理器,也印證了專屬晶片的核心價值——沒有絕對無敵的算力,只有最符合該場景的設計。

軟硬體「垂直整合」,才是好產品的關鍵

蔡家齊助理教授的研究專注於「垂直整合」,即從軟體演算法到硬體晶片一併考量,設計實用的 AI。雖然他曾投入車用 AI 研究,但因涉及複雜法規與實際上路測試的困難,目前團隊已轉向更適合學界發揮的多媒體嵌入式裝置領域。

現今所謂的 AI,包括內部運作的程式,以及外部執行的硬體。許多人覺得 AI 就是程式演算法,其實讓 AI 工作的裝置一樣重要。例如自駕車,除了 AI 演算法有優劣,搭載的裝置更是直接影響使用成效。

蔡家齊助理教授強調,想設計優秀的 AI,不能只關注軟體,軟體和硬體之間一定要能密切搭配。寫程式的人若能略懂硬體,設計硬體的人也懂一點軟體,才能打造出真正好用的 AI 系統。

AI 是新時代的發動機,人類更需掌握核心邏輯

從硬體設計延伸到軟體應用,AI 的高速發展也引發了另一個焦慮:人類還需要學寫程式嗎?

蔡家齊助理教授分享他的觀察:現在確實可以下指令讓 AI 幫忙生成絕大部分的程式碼。然而,完全依賴 AI 的風險在於,一旦程式發生 Bug,不懂原理的人將無從修正。更聰明的做法是,將大程式拆解成數個小部分交由 AI 處理,縮小問題範圍以利除錯,讓原本就熟悉程式邏輯的人,更能駕馭 AI 工具。

「AI 是新時代的發動機,大家不該排斥。」蔡家齊助理教授總結,只要掌握自身的專業,並懂得利用 AI 這項新工具,每個人都能在未來創造出屬於自己的新優勢。