在鋼鐵人的電影中,智慧助理 JARVIS 可以替鋼鐵人開燈關燈、尋找資訊、甚至是修理鋼鐵人受損的元件。我們對於未來生活的想像,就像是鋼鐵人的生活,每個人都有專屬於自己的智慧助理。如今,Apple Siri、Google Assistant 等智慧助理,或是智慧音箱等技術產品已經出現在你我四周,我們已經可以透過「出一張嘴」,就可以命令機器替自己辦事。然而,這項前瞻的技術其實沒有想像中這麼簡單,所以才會常常聽到這些智慧助理說:「抱歉,我不懂你的意思。」究竟,智慧對話機器人內部的運作技術是甚麼?它們是如何聽懂人類語言的呢?

人類與機器人的「你來我往」是怎麼辦到的?

大家常見到的這些智慧助理,都是透過對話(包含口語對話和文字對話)的方式跟人類進行互動,並且了解使用者意圖,協助其完成任務。在這裡我們要談到的重點軸心就是對話系統 (Dialogue System; Conversational Agent),對話系統的目標就是透過機器來模擬真人助理或是客服人員的行為,所以我們需要試著角色扮演助理或客服人員,思考他們需要做的每件任務,並且試著讓這些真人處理的事能夠自動化。

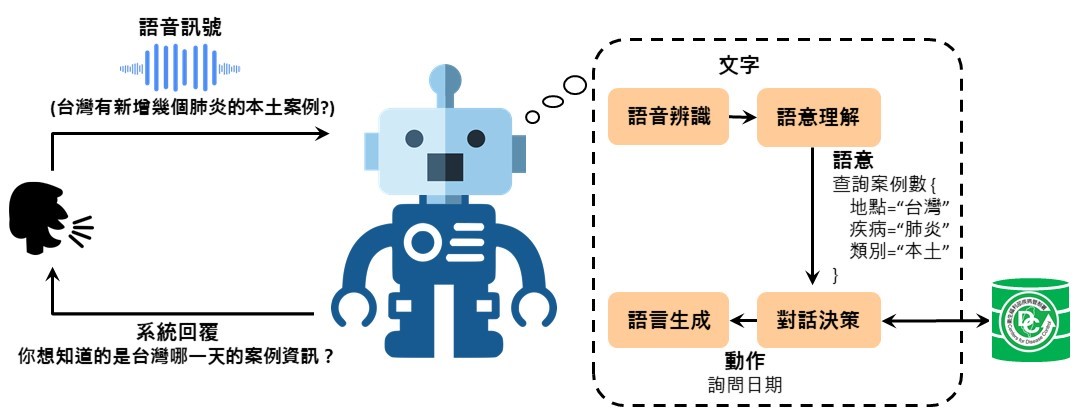

在對話系統中,機器內部流程就像是一個真人的助理所做的每件事,包含聽懂使用者所述的內容,並且協助使用者找尋資訊,進而產生對應的互動等,皆為機器需要自動化處理的任務。如圖一,市面上所看到的對話系統,都是使用同樣的流程架構來自動化對話互動的行為。對話系統中主要分成四個部分,語音辨識 (Automatic Speech Recognition; ASR)、語意理解 (Natural Language Understanding; NLU)、對話決策 (Dialogue Management)、以及語言生成 (Natural Language Generation; NLG)。

圖一:對話系統內部流程(圖/台灣大學教授陳縕儂提供)

如圖一所示,整個系統中有四個主要的部份,我們稱為四大元件,在一次的來回對話中,四個任務接在一起,才會是平常真人助理簡單的一次回應。以下我們一一簡述這四個任務到底是什麼:

1. 語音辨識 (Automatic Speech Recognition, ASR)

語音辨識是將語音的聲音訊號轉變成對應的文字,現今我們已經在各式各樣的產品上都可以看到此技術;舉例來說,我們可以直接在寫訊息時,透過麥克風利用聲音的方式進行輸入,手機可以透過此技術自動判斷聲音訊號所對應的文字,並且節省使用者手動輸入文字的時間。在整個對話系統中,使用者可以用口語或是文字的方式輸入資訊,語音辨識的技術則需要在輸入是語音的時候,將輸入轉成文字,再讓後續元件處理文字的資訊。

2. 語意理解 (Natural Language Understanding, NLU)

語意理解是將文字之輸入轉成對應機器可以理解的意義,就像人類在學習語言一樣,需要將文字的資訊轉變成腦中抽象的意義,所以我們也需要將前面元件傳過來的文字資訊「台灣有新增幾個肺炎的本土案例?」轉變成機器可以理解的描述方式,以上面的例子來說,機器需要知道現在需要「查詢案例數」,而且其中的案例條件包含了「地點」、「疾病」及「類別」,機器可以理解轉變後的語意,進而找尋相關的資料,以回答使用者的問題。

3. 對話決策 (Dialogue Management)

在前一個任務中,機器應該已經能夠理解人類所講述的內容,並且找尋相關的資訊,但是,要如何回應使用者,也是一項困難的任務。因為使用者有可能給的訊息不夠充分,機器必須要另外詢問其他資訊,例如,除了地點、疾病、類別等條件以外,使用者並沒有說明他希望查詢的案例日期,所以機器應該要先詢問日期的資訊,才能夠查到精準的資料。另外,也有可能是前面獲得的語意不夠清楚,比如說,聽不清楚使用者說的地點是「台灣」還是「泰國」,需要再次詢問並確認。因為對話可能很複雜,所以會有許多可能的應對情況,這都需要透過對話決策來決定應該如何回應使用者,才能傳給下一個元件生成對應語言。

4. 語言生成 (Natural Language Generation, NLG)

對話決策決定了回應的動作後,語言生成元件將動作轉成機器實際上回給使用者的語言,如圖一,當機器決定詢問日期,就會生成「你想知道的是台灣哪一天的案例資訊?」,讓使用者可以與機器對話,並且提供相關的日期資訊,以便找尋到使用者需要的精準資訊。

生活中處處可見 隨時都能與您聊聊

在現在技術發展飛快的世代,這項對話系統的技術幾乎是處處可見。透過前面技術的介紹,我們可以發現,這項技術其實可以應用在許多不同的場域及主題上。以下提供幾個應用場景讓大家了解,這些機器人,都是透過相似的流程進行其中的互動規劃,但是目標都是完成不同場域的任務。

1. 醫學疾病相關

大家應該都對許多 Facebook 或是 LINE 上面的聊天機器人不陌生,就如圖二所示,隨著新型冠狀病毒疫情延燒,疾管署推出的官方帳號「疾管家」,可以透過簡單的對話方式,查找一些相關資訊,非常便利,「附近哪裡買得到口罩?」也難不倒。

圖二:疾管家介面及對話互動範例。圖/疾管家

2. 金融銀行相關

圖三是玉山銀行與國泰世華各自的智慧客服系統,一樣是透過簡單的對話或是點選的方式,讓使用者便於查找相關訊息。許多領域都有客服中心給使用者詢問相關訊息,例如:票務中心協助訂票或回答票務資訊、餐廳協助使用者訂位等,都能夠透過相似的技術,讓使用者可以更簡單快速的獲取需要的訊息。

圖三:隨身金融顧問—玉山銀行小i和國泰世華阿發。圖/隨身金融顧問

3. 家庭生活相關

相信現在大家已經看過很多智慧家庭的一些設備,像是智慧冰箱、智慧電燈等,透過物聯網的技術,可以藉由手機等方式控制家庭內部的許多電器。然而,這些物聯網的設備,可以更進一步與對話服務結合,讓使用者不僅是透過點選按鈕的方式控制設備及電器,也可以用自然語言的對話方式進行互動。如圖四所示,智慧家庭的建立可以經由一個智慧音箱,連接許多智慧電器,並且透過跟音箱的語音指令,控制家庭中許多的電器,讓家庭生活更便利。

圖四:物聯網科技建構之智慧家庭。圖/VectorStock

在國立台灣大學資訊工程學系裡有一由陳縕儂教授帶領的機器智慧與理解實驗室,主要是針對語言處理及對話系統等相關技術進行研發及精進,藉由最前瞻的機器學習技術,透過資料讓機器自動學習如何理解人類語言並且進行適當的互動,期望能讓機器的效能媲美人類,甚至是超越人類。

近期陳教授的研究方向是什麼呢?

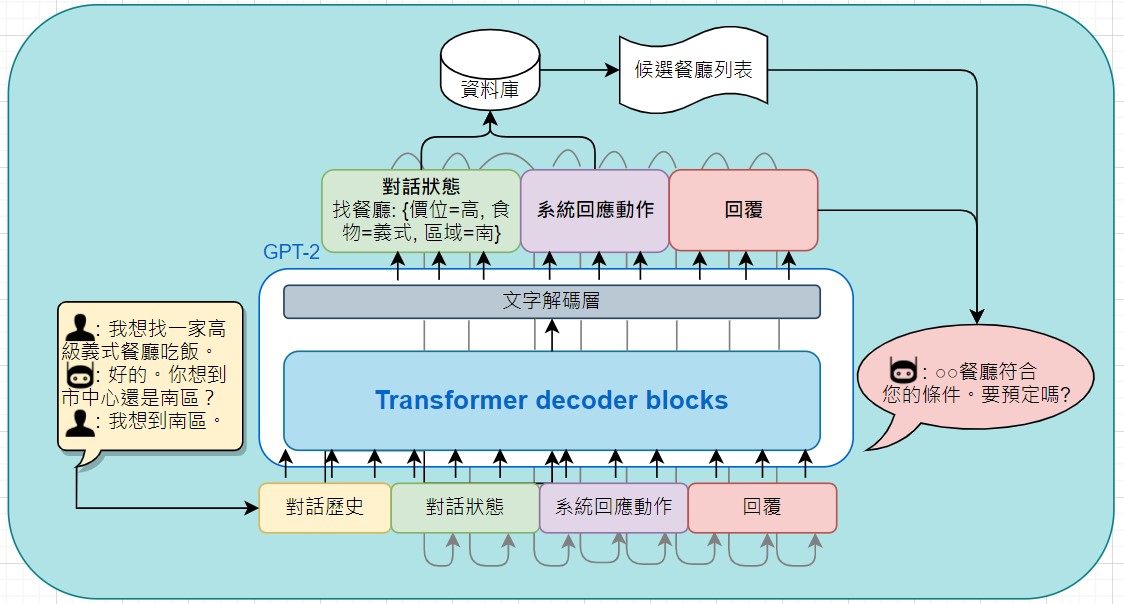

如前所述,對話系統裡面具有多個元件,而每個元件都隨著日漸更新的技術不斷改進其效能。以語意理解為例,傳統用各式機器學習之技術,進展到近期幾乎所有模型都使用最前瞻的深度學習技術來建置此元件。而在此領域中,近期最大的研究突破已有將整個對話系統用同一個模型來完成,不需要讓每個元件各自對應一個模型,所有任務都只靠一個模型完成。如圖五,可以清楚的看到下方有一個大模型,可以從對話內容 (Dialogue history) 生成對話狀態 (Dialogue state) 以完成理解對話語意內容,接著藉由此內容判斷對應的系統回應行為 (System action) 而完成決策,最後經由此行為生成對應之自然語言回覆 (Response)。多個任務全部交給同一個模型來完成,這樣一來,所有的資訊都可以訓練在其中,也不需要每個任務分別維持一個模型,可以達到下降整個系統模型所需之參數,對於現今許多 IoT 的裝置,無疑是一個加分。然而,目前這樣的單一模型作法並未實際應用在產品上,主要的原因是,現在的模型所達到的系統效果,不如分開串接的模型來的好,所以此領域的學者們依然致力於提升其效果,期望這樣的作法可以成為未來之趨勢。

圖五:端對端單一模型之任務型對話系統。圖/轉譯自參考資料 5

從前看似科幻的事,如今在生活中已處處可見且稀鬆平常,相信經過特訓後,機器人與我們的對話也將越來越自然、順暢,這樣的成果為人們的生活帶來無比的豐富和便利,是不是應該為著研究開發者和這些很給力的智慧好幫手鼓掌歡呼一下呢?

本著作係採用 創用 CC 姓名標示─非商業性─禁止改作 3.0 台灣 授權條款 授權.

本授權條款允許使用者重製、散布、傳輸著作,但不得為商業目的之使用,亦不得修改該著作。 使用時必須按照著作人指定的方式表彰其姓名。

閱讀授權標章或

授權條款法律文字。