回顧人類歷史,幾乎每一場科技革命背後,都有一種主導時代的能源。

第一次工業革命仰賴的是煤炭。煤燃燒產生蒸氣,推動機械運轉,讓手工走向機械化。隨後,世界進入石油時代,汽車、飛機與軍事裝備都依賴石油驅動。在那個階段,誰掌握了石油,誰就擁有更大的國力與國際影響力。隨著發電機與電網普及,人類進一步進入電力時代,能源轉換成電力,供應城市、工廠與家庭使用。

但在數位化的今天,國力的衡量標準似乎悄然翻篇。前英特爾執行長季辛格(Pat Gelsinger)曾表示,對人類而言,半導體比石油在哪裡更重要。《晶片戰爭》作者克里斯.米勒(Chris Miller)也指出,掌握晶片的人,就更有機會主導科技發展,甚至是未來的全球競爭。與此同時,總統賴清德也強調:「算力就是國力。」

這顆微小的晶片究竟是如何在短短數十年間,從無到有地架構起現代社會呢?

從真空管到晶片:數位世界的起點

最早的電子電腦,靠的是真空管(Vacuum Tube)來充當電子開關。它體積龐大、耗電驚人,穩定性也很差,因此難以普及。直到 1947 年,美國貝爾實驗室(Bell Labs)的科學家約翰・巴丁(John Bardeen)、華特・布拉頓(Walter Brattain)與威廉・肖克利(William Shockley),利用半導體(Semiconductor)材料發明了電晶體(Transistor)。和真空管相比,電晶體更小、更省電,也更可靠,很快就被用在助聽器與收音機等消費電子產品上。

但新的問題很快又出現了。當一臺設備需要的電晶體越來越多,若要靠人工把它們一個個焊接起來,不只麻煩,也很容易出錯。於是到了 1958 年,德州儀器(Texas Instruments)的傑克・基爾比(Jack Kilby)做出第一個積體電路(Integrated Circuit, IC);隔年,快捷半導體(Fairchild Semiconductor)的羅伯特・諾伊斯(Robert Noyce)提出更適合量產的方法,把原本分散的電子元件,整合進同一塊半導體材料裡,這就是晶片。

接下來,微影技術(Photolithography)又把這件事往前推了一大步。工程師終於能像「印刷」一樣,把越來越細小的電路圖案刻在矽晶圓(Silicon Wafer)上,讓晶片能大量生產,使晶片從實驗室走向工廠。

起初,這些昂貴而尖端的技術,主要仍服務於軍事與太空計畫。直到羅伯特・諾伊斯透過大幅降價的策略,逐步打開民用市場;而英特爾(Intel)在 1971 年推出的 4004 微處理器(Intel 4004 Microprocessor),則首次把原本需要許多元件才能完成的運算功能,濃縮進一小塊晶片之中。從那之後,晶片的應用一路擴展,從個人電腦、家電、手機到網路設備,再到今天的雲端運算與人工智慧,成為數位世界運作的底層基礎。

算力是高度精煉的組合式資源

國立中央大學電機工程學系李進福教授指出,半導體是材料,晶片是以這種材料製成的元件,算力則是晶片所展現出的運算能力。若放在同一個脈絡下理解,半導體像金屬,晶片像用金屬打造的汽車,算力則像汽車能輸出的馬力。也因此,當前各國競逐的焦點,已經從晶片本身延伸到晶片所承載的算力。

在李進福教授看來,算力並非天然存在的能源,反而更接近一種高度精煉的組合式資源。它的生成牽涉許多環節:電力來自石油、天然氣、太陽能或風力等能源轉換;晶片仰賴設計與半導體製造,背後還需要人才、設備與完整產業鏈支撐;到了系統端,還得進一步整合電源供應、資料傳輸、散熱與封裝等能力。換句話說,算力是跨國產業鏈協作與系統整合後,才能形成的結果,並非單一技術的產物。

也正因如此,在這個時代,擁有能源或技術固然重要,但誰能在這條組合式、跨國供應鏈中佔有一席之地,也同樣關鍵。這也解釋了,為什麼缺乏天然資源的臺灣,仍可能在算力時代扮演重要角色。

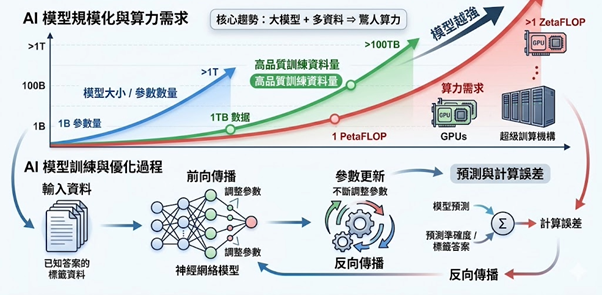

圖 2 AI 模型越強,通常代表模型越大、參數越多,也需要更多高品質資料來訓練。訓練的過程,就是利用已知答案的標籤資料,不斷調整模型參數,讓預測更準確。也因此,模型越大、資料越多,對算力的需求通常也越驚人。

圖片來源:李進福教授提供

為什麼 AI 這麼吃算力?

李進福教授指出,過去的電腦或手機,大多是照著既定規則執行任務,所以需要的運算量相對有限;但人工智慧不一樣,它不是照規則做事,而是要從大量資料中學會怎麼判斷。也因此,人工智慧要處理的內容越多,模型裡需要調整的參數就越多。

大語言模型的運算基礎,主要是不斷重複的乘法與加法,也就是乘積累加運算(Multiply Accumulate Operations, MAC)。例如你對 AI 說一句「幫我寫一封請假信」,AI 並不是一次就把整段答案想好,而是把回覆拆成一個一個詞,逐步算出下一個最可能出現的詞。以 GPT-3 為例,這類大型語言模型的參數規模可達約 1,750 億個。這意味著,模型每生成一個詞,都需要調動大量參數進行運算,計算量往往落在數百億到數千億次等級。若是一句約 20 個詞的短回覆,整體所需的運算量就可能上看數兆次浮點運算(FLOPs)。這也是為什麼,今天大家看到的不只是人工智慧的發展,還有背後對算力、晶片和電力的競爭。

算力會短缺,還是過剩?

不過,當全球都在加快興建資料中心、搶晶片、搶電力時,市場也開始出現另一種疑問:AI 帶動的算力需求,究竟會一路成長下去,還是只是短期熱潮堆出的泡沫?對此,李進福教授表示,無論是外界擔心的「算力荒」,或是相反的「算力過剩」,目前都還沒有出現足夠明確的訊號。

如果從「算力荒」來看,未來確實可能遇到一些限制,例如:物理極限、能源消耗,或晶片製造能力不足。不過,這並不代表算力成長已經走到盡頭。像是太空資料中心、小型核反應爐等新方案,雖然目前多半還在研究、驗證或評估階段,但若未來逐步成熟,仍有機會緩解能源壓力,進一步提升算力供給。

至於「算力過剩」,前提則是 AI 應用需求開始停滯,甚至不再成長。但就目前來看,這樣的情況也還沒有出現。無論是自駕車、智慧製造與自動化,還是智慧機器人,都還在快速發展,代表對 AI 的需求仍在擴大。另一個變數則是模型本身的演進方向:未來 AI 是否能很快走向更高效率的路線,用更少運算達到同樣、甚至更高的準確度,現在也還沒有明確答案。

不過,李進福教授也提醒,臺灣雖然在晶片製造與系統整合上具備優勢,但這場算力競逐的關鍵,還包括電力供應。隨著資料中心快速擴張,如何提供充足、穩定且具韌性的電力,支撐算力持續成長,已成為全球共同面對的挑戰。

此外,算力並不是沒有代價。無論是發電,還是晶片製造,本身都要付出相應成本。晶片製造需要大量的水與電;而電力生產則取決於發電方式,可能伴隨污染、碳排,甚至核廢料等問題。換句話說,當各國都在追求更強算力時,真正的挑戰不只是把算力做大,還包括如何在發展、能源與環境之間,找到一個能兼顧永續與國力的平衡點。